Nouvelle version de Houdini :

Le 12 Août 2025 Side-FX nous dévoilait la dernière version de Houdini lors de sa Keynote « Houdini 21.0 » au SIGGRAPH 2025 à Vancouver, Canada. L’occasion d’en apprendre bien plus sur cette nouvelle version de Houdini qui devrait être disponible fin Août.

On fait le point avec vous sur les nombreuses nouveautés. Si vous n’avez pas vu notre article sur Houdini 20.0 ou la 20.5, c’est par ici.

Houdini 21.0 est une version importante (comme souvent) mais comme l’explique Critin Barghiel lors de l’introduction, ce qui rend cette version majeure c’est qu’elle consolide les outils existants pour les rendre véritablement « production ready » ! En clair, pas de nouveau contexte mais moins de bug, plus de performance, plus de contrôle et une utilisation facilitée.

A quoi peut on s’attendre ? de très nombreuses recettes (recipes) dans tous les contextes. Des outils améliorés et plus pratiques à mettre en place en quelques clics pour l’animation. Une simplification d’APEX au travers de nodes KineFX pour le rig et d’un autorig modulaire. Des outils Copernicus (texture / compo) qu’il manquait avec des interactions viewport, des solvers 2D/3D et un nouvel outil de bake de texture ultra rapide. Un viewport Vulkan plus robuste et fonctionnel sur Mac. Des outils de shots builder, un asset résolveur et une render gallery en IPR pour Solaris. Le moteur Karma XPU est encore plus performant. Le solver MPM devient utilisable sur des géométries avec uv. Les heightfield sont améliorables via le COP, le Machine Learning (ML) et un nouvel outil d’érosion. Les outils de muscles sont repensés, plus rapide à mettre en place sur des créatures et personnages. Il y a maintenant des exemples de vrais outils de ML utiles. Et bien d’autres améliorations listés plus bas dans cet article.

Au sujet de Machine Learning, Cristin tien à nous rassurer en expliquant que l’IA (ou le ML) dans Houdini ne seront jamais là pour supprimer nos emplois mais toujours pour mettre en avant nos compétences et faciliter notre travail.

Houdini 21.0 est disponible depuis le 27 Août en téléchargement, et on vous rapelle qu’une version gratuite « apprentice » vous permet de tout tester.

Du 23 au 25 septembre à Toronto se déroulera le Houdini Hive Equinox (réservez vos places ici). L’équivalent de 5 jours de conférences en 3 jours. Vous ne pourrez pas tout voir en direct, mais des replays seront bien sur disponibles par la suite, on les postera ici !

Houdini 21.0 Sneak Peek

Houdini 21.0 Keynote

8 conférences sur le COP, le terrain, le MPM, le ML, le rig facial ou les muscles ont eu lieux au SIGGRAPH, environ 6 heures de vidéos complémentaires pour découvrir certaines des nouveautés de Houdini 21.0.

Animation Tools and Graph Editor

Animation catalog : De la même manière que les catalogues de shaders ou d’USD, l’animation catalog permet d’enregistrer les poses et les animations des personnages dans une banque avec des miniatures de preview éventuellement animées et des metadata.

Ça ressemble très fortement au plugin Maya « Studio Library ».

En plus de permettre d’appliquer le clip d’animation à un nouveau layer en choisissant le range de la timeline et le mode d’application de l’animation, un paramètre de blend permet de transitionner entre l’état actuel et celui du clip d’animation. En sélectionnant les contrôleurs d’animation il est possible d’appliquer le clip qu’à ceux-ci. Bien entendu les animations sont transférables vers un autre rig s’il est défini de façon similaire.

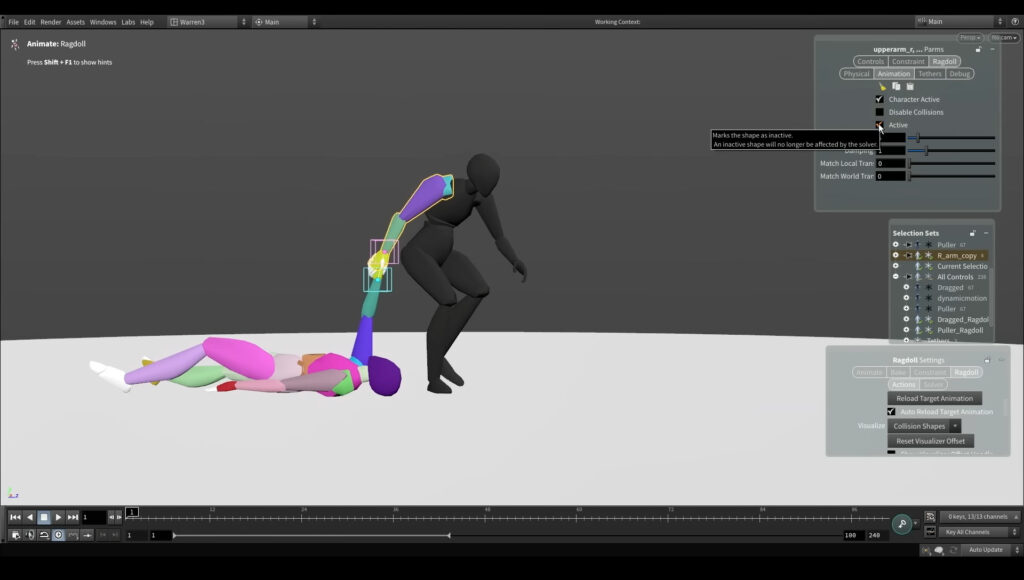

Ragdolls : L’animation dans Houdini utilise de plus en plus les ragdolls (RBD) de façon transparente. SideFX nous présente l’option « Tether » qui permet d’ajuster la résistance (stiffness) de l’attache d’un élément de ragdoll à un autre (ragdoll ou pas). Permettant d’avoir un personnage dont certains membres, par exemple les pieds, sont attachés à l’animation d’un véhicule et le reste du corps qui subit le mouvement dynamiquement. De la même manière pour avoir un personnage qui en tire un autre par la main, on va animer le premier et simplement sélectionner les deux mains et appuyer sur « h » pour créer la contrainte dynamiquement.

Contrainte en raccourcis : le raccourci « h » permet donc d’attacher des contrôleurs pour les contraindre ensemble (sous forme d’attache avec un transform identique ou de parentage maintenant l’animation de l’enfant). Comme lorsque qu’un personnage prend un objet dans la main. On contraint l’objet dans la main pour qu’il suive l’animation, ou à l’inverse on contraint la main à l’objet pour bouger ce dernier et entrainer le main et tout le bras en IK. Cette contrainte à la volée à aussi un offset invisible permettant d’animer la position de l’un par rapport à l’autre sans la désactiver, comme pour faire glisser la main sur l’objet qui la contraint. Il est aussi possible de switcher vers d’autres types de contraintes que l’offet, comme le lookat ou multidriver.

« h » permet aussi de punaiser des points lorsque l’on est en mode « Full Body IK ».

On rappelle que le raccourci « ctrl + shift + clic » arrivé avec Houdini 20.5 permet d’animer un ou plusieurs contrôleurs en fonction du pivot du dernier sélectionné, comme s’il créait une contrainte d’offset à la volée.

APEX Scene Add Prop : Cet outil a été mis à jour pour fonctionner sur des éléments pré-fracturés et les simuler en tant que ragdoll, permettant d’avoir des simulations de type RBD (static, animated ou déforming) comme un objets qui tombe en morceaux avec comme impulsion de vélocité l’animation précédente. L’avantage de faire cela en animation et non en FX est que chaque élément obtient un point avec un transform sur lequel est appliqué son animation et que celle ci est bien plus facile à corriger avec les outils d’animation.

Skin contrôls : L’option dans les parameters (« p ») « Use Skin Controls » permet de masquer les contrôleurs et de les diriger en cliquant sur les géométries qu’ils dirigent. Aussi appelé « direct skin manipulation », ça semble fonctionner en « screen space ».

Motion Mixer : Le motion mixer ou animation mixer est repensé pour rapidement importer des clips d’animation, les séquencer et les mixer. Warren Leathem nous présente une scène où il aligne la position d’un clip de saut à la fin d’une animation de course comme on le fait avec les options de locomotion de kineFX mais cette fois-ci en un clic et avec le raccourci « ctrl + m ».

Les clips séquencés peuvent bien sur être animés en override avec des layers ou des motion paths. Le motion mixer permet d’accéder aux clefs d’animation de la séquence voulue et donc d’animer sans changer de vue. Il est très inspiré de l’interface de Motion Builder, mais la différence importante, c’est qu’ici les clefs d’animation ne sont pas bakées.

Display des contrôleurs : Les paramètres d’animation (« p » au dessus du viewport) ont une option pour masquer les contrôleurs d’animation pendant le playback. Deux nouvelles options viennent enrichir ce menu pour masquer les contrôleurs lorsque l’on « scrub » dans la timeline ou que l’on clic-drag sur un contrôleur. Toutes pour mieux visualiser le résultat de la déformation sans afficher les contrôleurs au dessus des meshes.

Handles : Dans les préférences il est maintenant possible de modifier les positions, offset et échelles des poignées d’animation dans le viewport manuellement ou avec des presets.

Tracking d’animation manuelle : Possibilité d’enregistrer le mouvement pour créer une animation en temps réel lors de la transformation des contrôleurs.

APEX / KineFX

Section en cours d'écriture.

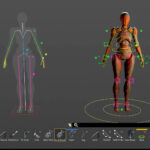

Esther Trilsh débute sa présentation des nouveautés d’APEX en expliquant qu’en animation, tout ce passe dans le viewport de façon intuitive et que ce principe est maintenant transféré pour le setup / rig.

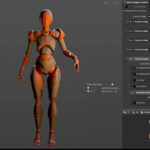

Assets de personnages

Électra : Est mise à jour avec les nouvelles options de contrôleurs

Otto : Un asset de personnage avec géométrie, texture, squelette modélisé, rig et son système de muscles. Voir section muscles.

Le rig d’Otto semble épuré tout en ayant des options avancées comme un blend IK/FK, un blend de stretch, un auto positionnement de la clavicule, de l’omoplate ou de la rotule ou encore un système avancé d’IK pour les doigts.

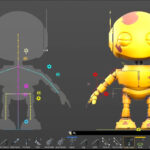

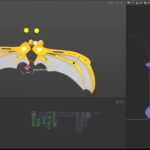

Harry : Un nouveau personnage robotique avec des ailes. L’asset à sa géométrie, ses texture et son rig et des options pour afficher ou les ailes.

Wormy : Un ver de terre avec sa géométrie, sa texture et son rig basé sur une curve. On y retrouve des options pour définir lors de l’animation le nombre de contrôleurs souhaités.

Pirate : Un pirate avec sa géométrie, sa tenue, ses textures, son rig et son groom riggué lui aussi. Il dispose de contrôleurs de blendshape qui suivent la déformation du mesh et une vus schématique du visage appelée « side pannel ».

Rig components

AutoRig : L’autorig builder est grandement amélioré. Le component catalog fait son apparition. Un simple drag & drop d’un component (module) sur les guides permet de générer le rig et ses contrôleurs. Tout est basé sur les tags, ces attributs sur les points des guides pour mapper automatiquement les bons éléments. Et si vous drag & dropez dans le vide, cela crée un nouveau guide pour une nouvelle partie du corps.

On note que la rest position du rig peut être ajustée en IK ou FK et que le rig se met à jour à tout ces changements en temps réel, même pendant que vous le construisez.

Curve rig component : Ce système de rig basé sur une courbe dispose d’outils pour les animateurs comme la possibilité de changer à la volée le nombre de contrôleurs qu’ils souhaitent le long de la courbe. Les animateurs peuvent aussi définir un nombre de « pin control« . Ceux-ci définissent l’écrasement de la géométrie entre deux pin control en glissant sur la courbe, un peu à la manière du squish pivot du linear taper avec un contrôle supplémentaire pour le stretch & squash et un autre pour la rotation.

Ca semble très flexible et pratique pour mettre en place un rig biped en quelques minutes.

Slider controls : Un node de « blendshape slider helper » permet de définir des contrôleurs de blendshape à base de courbes « snapées » sur la géométrie. Ces contrôleurs et leurs courbes viennent automatiquement suivre la déformation de la géométrie afin que l’animateur ressente un vrai lien entre le mouvement du contrôleur et la blendshape.

APEX add groom : permet de rigger du groom. Il déforme le grooming à base de bones FK généré sur les curves sélectionnées. Voir la doc ici. Ca peut être sympa combiné à un « secondary motion » .

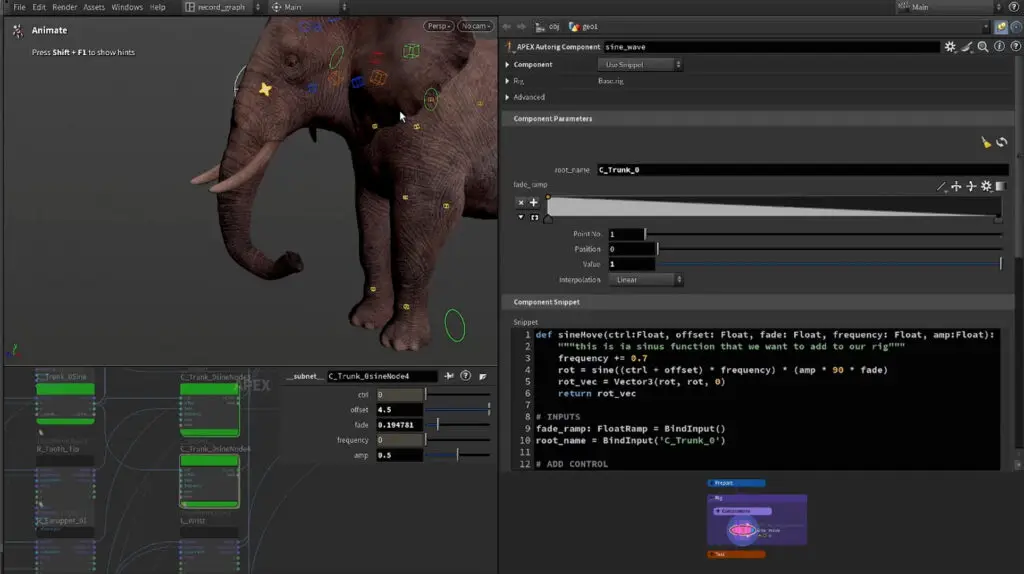

APEX Script / Graph : Pour les parties de rig non conventionnelles, vous pouvez écrire votre rig via l’APEX script ou le développer en nodes via l’APEX graph. C’était déjà le cas dans Houdini 20.5, mais maintenant vous pouvez en faire un outil et l’intégrer au rig. Il est même possible de combiner un rig FK classique avec un rig IK développé en APEX script ou graph.

Fuse Graph : Votre rig modulaire développé avec l’APEX Graph ou Script fonctionne, vous pouvez l’enregistrer en tant que rig component. Ainsi vous le retrouverez dans le « component catalog » afin de le réappliquer à d’autres personnages en quelques clics ( un pour créer le guide, un autre pour générer le rig).

Contrôleurs de rig

Skin Control : Comme expliqué dans la section animation, il est possible de diriger un rig simplement en cliquant sur les parties de la géométrie sans afficher les contrôleurs. Pour mettre en place ce système, sur le node « APEX Configure Control« , on peut simplement définir un groupe de face correspondant à la transformation d’un contrôleur.

Side panel : C’est une vue synoptique qui permet d’avoir les contrôleurs du visage sur un schéma de la tête afin d’épurer la visualisation de la déformation du personnage. L’animateur peut passer de cette vue à celle des contrôleurs au dessus du visage selon ses envies et bien sur les contrôleurs du « side panel » peuvent être ajustés.

Configuration Controls : Des visuels attachés aux éléments du rig dans le viewport permettent d’ouvrir de nouveaux menus de type dropdown d’icones pour modifier des propriétés du component, ils s’appellent les « Controls buttons ». On y retrouve des options de miroir, d’IK/FK blend, d’ajustement de rest position, de couleur, de forme des contrôleurs et tout ce qui est utile à l’ajustement du rig sans avoir besoin d’ajouter des nodes ou même de visualiser la networkview ou la parameter view.

Lorsque vous développez vos propres modules, vous pouvez définir vos propres « control buttons » et les actions qu’ils auront. Tout est en python, ce qui fait qu’il est simple d’appliquer une action de pipeline. On nous présente des exemples qui permettent d’afficher un équipement du personnage ou de le retirer via un toggle ou d’ouvrir une page web d’aide.

Interaction Gadgets : Il est possible d’aller plus loin avec cet outil complètement ouvert à votre imagination. Les gadgets sont les outils interactifs via python state dans le viewport que vous pouvez obtenir via les « control buttons ». Il est possible de créer votre propre gadget. Dans la Keynote, on peut voir un APEX script qui dirige le look du gadget d’un « control button ». Je vous ai perdu ? Je la refais : On peut voir un code APEX avec des paramètres permettant d’ajuster le style des outils interactifs dans le viewport. Ces outils que l’on ouvre avec les « Control buttons ». Par exemple un bouton permet de définir l’angle maximum qu’utilise la palette de couleur radiale, ou la longueur de palette de luminosité ou encore l’échelle des cercles de couleurs.

L’avantage avec ça, c’est que vous n’avez pas besoin de vous créer un plugin pour les rigger ou animateurs compatible avec la bonne version de votre logiciel. Ici tout ce fait dans Houdini, vous itérez directement sur votre rig ou personnage de façon interactive et vous l’enregistrer dans votre rig.

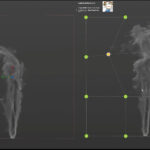

Autres outils

Rig Transfert : Le node d’APEX Autorig Builder dispose d’un second output appelé « rig template« , connectez le à un autre « APEX Autorig Builder » pour transférer le rig d’un personnage vers l’autre. Retrouvez l’option « input » dans le component catalog, drag & dropez la sur vos guides et votre nouveau personnage obtient le même rig que le précédent grâce à un système d’analyse de la hiérarchie. Même si ce nouveau rig à des noms, de la hiérarchie et des orientations différentes, il semble trouver son chemin.

Et comme tout est basé sur les tags à nouveau, vous pouvez obtenir un résultat adapté à votre personnage qui à par exemple plus de joints.

Corrective joints using ML Regression : Un système de Machine Learning entrainable à partir de peu de données permet de prédire les corrections à appliquer aux joints lors de vos mouvements. Ça semble très pratique !

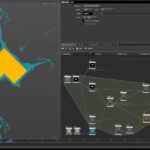

COPs

Énormément de choses côté COPs, des solvers, des presets , un scatter, des curves, des déformers et un peu de compo :

COP Solvers

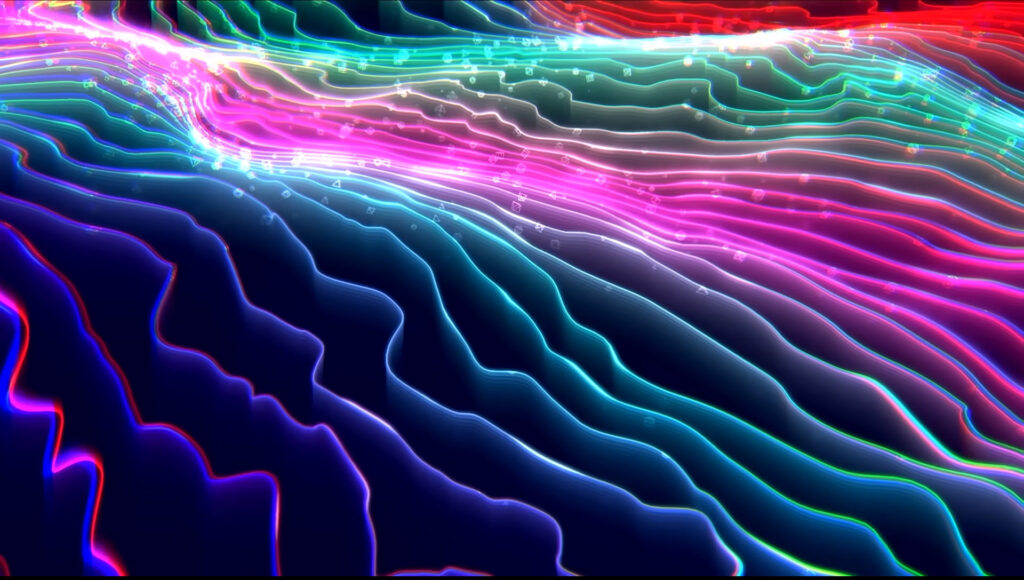

Flow solver est une simulation GPU de fluides 2D en temps réel. On y trouve un paramètre de buoyancy et de buoyancy direction pour définir dans quelle direction et à quelle vitesse se déplace les informations de pixels.

Il est possible de définir une source de température pour la buoyancy à partir d’une image mais aussi d’utiliser une collision 2D. Comme c’est du COP, la simulation et tileable

Le solver est en fait un block de début un block de fin, permettant d’ajouter des nodes entre deux qui seront exécutées sur le contenu pendant la simulation. Un peu comme un SOP solver. Dans la Keynote un node de bright avec une valeur inférieure à 1 permet d’assombrir la température et ainsi de la dissiper dans le temps comme pour du feu.

Reaction diffusion solver : Ce solver souvent recréé en DOP par les artistes est maintenant disponible directement en COP sous forme de blocks. Ce qui permet à nouveau d’ajouter des opérations intermédiaires pour modifier le comportement.

Pyro solver : Encore un autre solver GPU accéléré (comme tout en COP), il s’agit d’une « sparse simulation » de voxels 3D. Le nouveau node de « Pyro Light Ambient » ou « Pyro light from points » permettent d’y ajouter des informations de lumière et le node « Rasterize Volume« permet de pixeliser le résultat en 2D sans passer par un rendu karma.

On aperçoit des entrées pour la densité, température, vélocité, divergence, collision et collision velocity sur le Pyro solver.

Des nodes de pyro solver seront disponible, comme « Pyro light scatter« , « Pyro source from layer » ou encore des micro solver comme le « Pyro buoyancy » ou « Pyro dissipate« , on a pas encore vu leur fonctionnement mais on se doute de leur utilité.

Ces solvers auront des presets disponibles pour avoir des exemples concrets permettant de comprendre plus facilement comment mettre en place un système fonctionnel.

Ils peuvent être utilisés pour générer des images mais peuvent aussi être renvoyées en SOP, DOP ou MAT pour diriger des points, instances, particules ou shaders par exemple.

Rappelons qu’ils sont compatibles avec le nouveau mode de lecture « live simulation » voir section interface.

Génération de textures

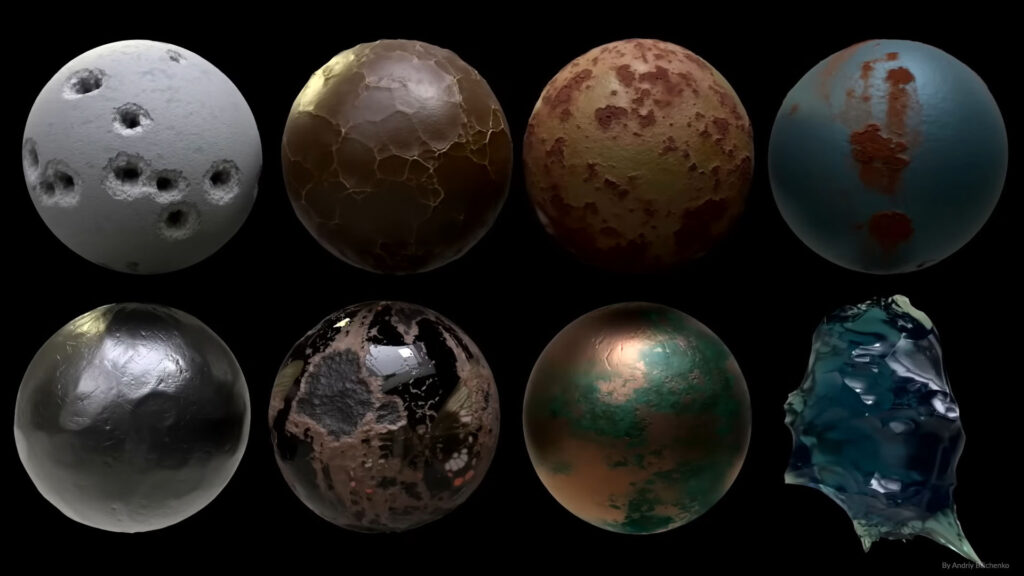

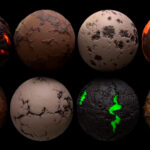

Librairie de matériaux : Une librairie d’exemples ou des recipes de matériaux devrait être disponible dès la prochaine production build. Celle-ci sera peuplée de shader plutôt réalistes et de textures construites via Copernicus.

Grunge maps : Des textures de « grunge » permettant d’ajouter du détail rapidement sans devoir tout faire manuellement seront prochainement disponibles.

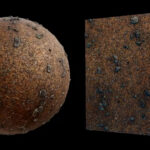

Triplanaire : Un nouveau COP node de « triplanar » permet d’utiliser la preview d’une texture sur une géométrie sans UVs. De la même manière un triplanaire en hex tiling sera présent.

Texture baking : Le système de baking à été complètement revu utilisant une librairie de raytracing accéléré par GPU commune à Karma & Copernicus. Cette nouvelle technologie permet de baker de façon temps réel (peut être plus long sur des assets lourds) et d’obtenir un résultat très similaire en utilisant Karma ou les COPs.

En COPs on retrouve une recipes de type tool (ça veut dire que vous la retrouvez dans le tab menu) appelée « Bake Setup » ou le node « bakeGeometryTexture » en lui connectant des « SOP import ».

Notons que baker les textures peut être encore plus intéressant avec le shading, pour celà il vaut mieux utiliser la version Karma expliquée ici plus bas.

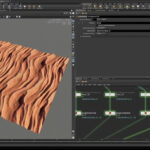

Phasor noise : Nouveau node de noise (bruit) permettant d’obtenir un look proche du « voronoi » étiré sur un axe et déformé par un autre, comme des dunes ou des vagues.

On devrait retrouver d’autres noises avancés comme Chladni (produit des cymatiques), Bubble, Cloud 3D, Crystal etc…

Light & shadow : Des nodes de light et de shadow devraient être disponibles en COP. Peut d’informations à ce sujet mais il semble évident qu’elles permettent de mettre en lumière ou d’ajouter des ombres, on imagine en fonction de la géométrie source ou des informations de depth / height d’une image.

Compositing

Côté compo, c’est un peu la déception, on nous indique à nouveau que Copernicus n’est pas encore un outil de compo, pas encore ! On aura tout le même droit à pas mal de nouveaux nodes :

2D adjust : « Color Correct », « Sharpen », « Defocus », « Wipe », « ToneMap »…

Live Video : Un nouveau node « Live vidéo » permet d’acquérir la vidéo d’une caméra branchée sur votre poste de travail. Permettant d’appliquer n’importe quelle opération de COP sur ce que vous filmez en direct. Scott Keating nous explique qu’il s’agit d’une première étape d’ajout de vidéo dans Copernicus mais que l’on peut déjà imaginer de futures applications comme du caméra tracking.

Surface dither : Permet de jouer avec un tramage fractal sur une image en entrée. Plaçant des points sur l’image en analysant le contraste, cette technique permet de comprendre le mouvement en ajustant la taille des points tout en maintenant leur espacement.

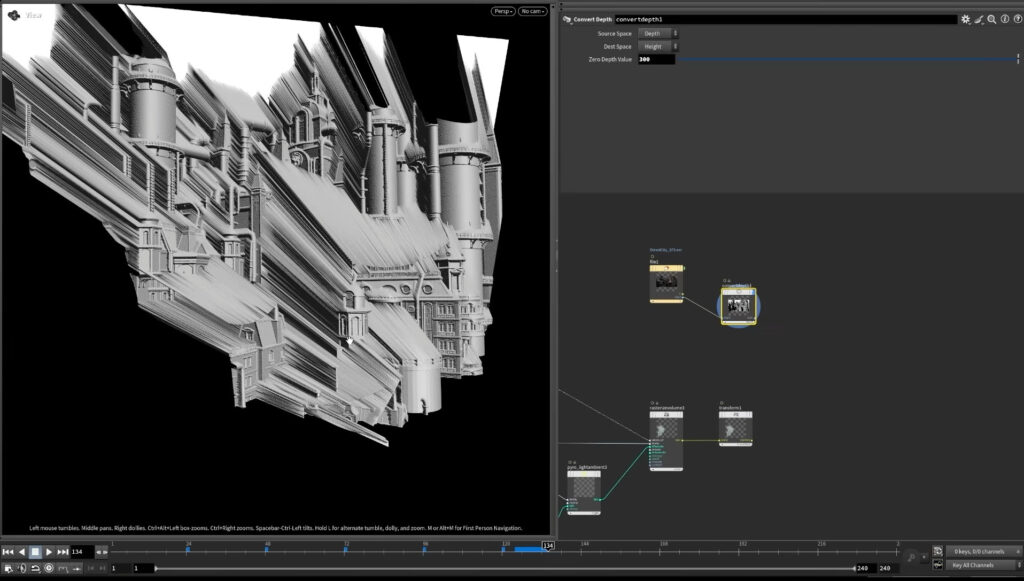

Convert depth : Permet de projeter les pixels dans l’espace 3D en fonction de l’information de depth ou de height.

Crypto matte : Génère un matte en « pickant » (via la pipette en python states) une ou plusieurs couleurs « index » de la passe de crypto.

COP filters : voir section Solaris.

Génération de formes

Motifs : un générateur de mosaïque et de motifs de type Escher avec des fonctions hyperboliques.

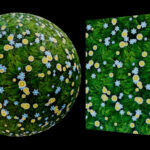

Scatter shapes : Ce outil basé sur sur le « stamp points » permet d’instancier des images sans passer nous même par des points en SOP.

On remarque des paramètres pour régler le jitter de position, l’échelle, la rotation, l’alpha ou la couleur des éléments, avec la possibilité pour chaque d’utiliser soit un input, soit une valeur constante soit un aléatoire.

Lors de la Keynode on peut apercevoir des exemples d’instanciation de formes graphiques pour du motion design mais aussi de formes plus réaliste avec des fleur, feuilles, rocher ou griffures sur des matériaux.

On note l’arrivée d’un node similaire, le « Curve scatter« , l’équivalent du copy to curve SOP en COP.

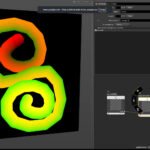

Curve 3D : Ce nouvel outil et simplement le « Curve SOP » mais dans le contexte de COP avec exactement les mêmes python states. On retrouve exactement les mêmes options qu’en SOP, Copernicus fonctionnant aussi bien en 2D qu’en 3D, il est possible de faire passer une curve au dessus d’une autre en vue orthographique.

Rasterize curve : Pixelise une géométrie de courbe avec des paramètres pour l’épaisseur ou le style de forme aux extrémitées, des options de ressample et d’uv de courbe.

Layer from curves : Similaire au rasterize permet d’avoir rapidement accès à des paramètres en fonction de l’UV de la courbe comme une couleur ou une épaisseur en fonction du U via des dégradés. Ce node à aussi sa version volumétrique : Layer from VDB.

D’autres nodes permettront de pixeliser des VDB par rendu, par tranche ou d’interpréter les valeurs float ou vectorielles pour les utiliser comme input.

Outils divers des COPs

Câbles pack : Deux nouveaux nodes « cables pack » et « cables unpack » font leur apparition, permettant de combiner ou de séparer plusieurs images un peu comme un tableau de valeurs dont chaque valeur est une image. Dans l’exemple de la Keynote, 3 formes sont « packées » pour ensuite être utilisée de façon aléatoire dans le « scatter shapes » afin de ne pas toujours avoir la même forme. Celà permet aussi d’appliquer des opérations à chaque image du « packed cables » comme via une boucle « for-each ».

Blocks begin / end : Un système de boucle avec feedback possible semble disponible, on ne l’a pas vraiment vu en action, mais ça semble fonctionner comme les solver.

Invoke : Ce nouveau node permet d’utiliser n’importe quel outil de SOP pour modifier le contenu de la géométrie présente en COP. On rentre dedans et on se retrouve dans le contexte de « Geometry ». Dans la Keynode Scott ajoute des attributs au points d’une courbe tracée en COP, ces attributs influent directement sur l’épaisseur ou la couleur des points de la courbe. On image très bien utiliser un node de « carve » ou autre pour animer la courbe ou toute autre géométrie.

Fetch : Permet de faire l’équivalent d’un « SOP object merge » en COP. Parfois appelé « téléport » il récupère le contenu d’un autre COP.

Python : Possibilité d’executer un code python sur une couche ou toute l’image.

USD : Il sera possible de charger / rendre des USD en COP.

Deformers : Encore de nouveau COP node, cette fois ci pour de la déformation 2D comme un « Bend« , « Lattice« , « Corner Pin » et « Swirl« . Pratique quand on sait que le faire sur un volume 3D est très lourd, ici si le volume est pixélisé en 2D, c’est temps réel.

On retrouvera aussi de la distortion avec « Heat distort by layer » et « Lens distortion« .

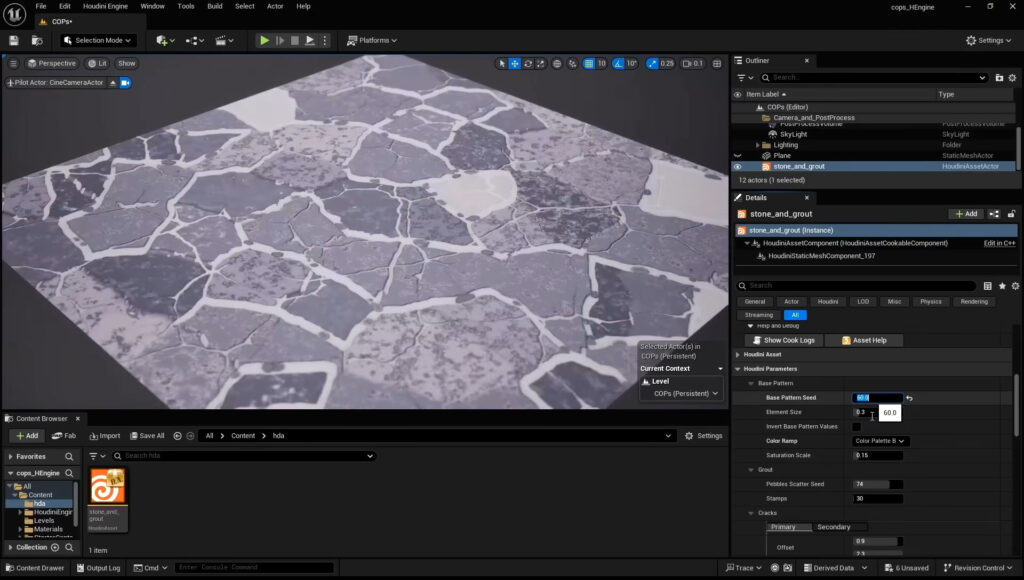

Houdini engine : Copernicus est maintenant supporté dans Houdini engine, vous pouvez donc maintenant modifier vos images depuis un moteur temps réel par exemple.

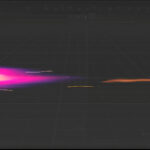

Pyro

Pyro thruster exhaust : Un nouveau système pour générer des effets de boosters / thrusters derrière vos vaisseaux spatiaux ou autres. Ce système est sans simulation, 100% procédural avec de nombreux contrôles artistiques. L’idée est de merger plusieurs node de PyroThursterExhaust ensemble pour obtenir un look riche.

Pyro presets : Enfin de vrais exemples pour le pyro solver avec des recettes (recipes) qui donnent des résultats intéressants, poussés et pré-intégré dans Solaris pour un rendu en quelques clics. On y retrouve un exemple de bougie, de boosters de vaisseau, des explosions, des débris en feu, de wispy smoke, de portail de feu, de la fumée froide…

COP sparse pyro (2D & 3D) : voir section COPs

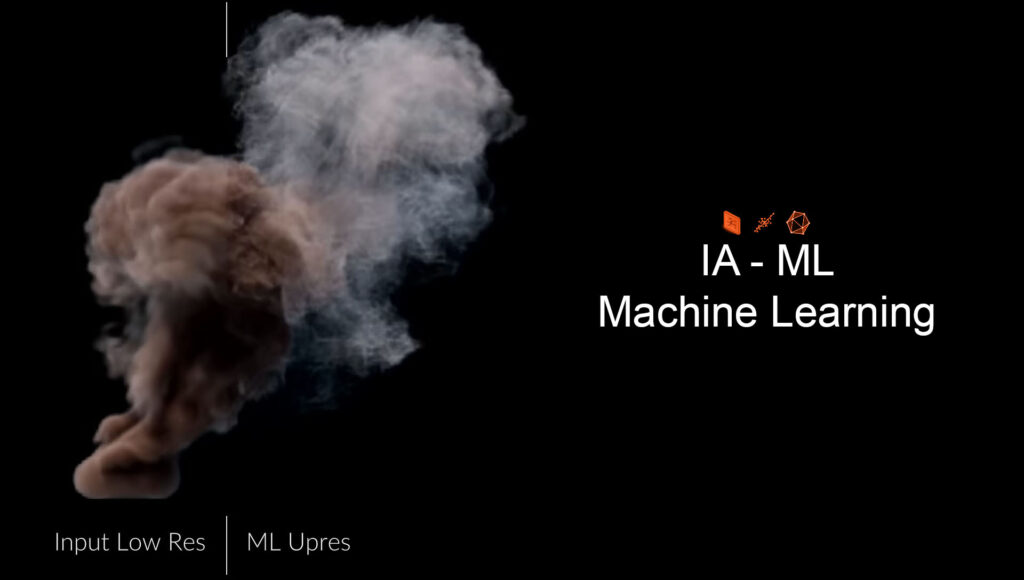

ML Pyro Upres : Ce système basé sur l’IA et plus précisément sur le Machine Learning permet d’augmenter la résolution d’un volume avec une cohérence dans le temps.

Des recettes (recipes) de cette solution seront disponible avec plusieurs modèles déjà pré-entrainé

Micro solvers : Quelques nouveaux nodes comme le « Gas burn« pour contrôler la dissipation du field de flame et emetre de la chaleur et de la fumée depuis celui-ci.

Mais aussi un « Gas Remap« pour décaler et changer l’echelles des valeurs scalaires de voxels

Zibra VDB :

IA - Machine Learning (ML)

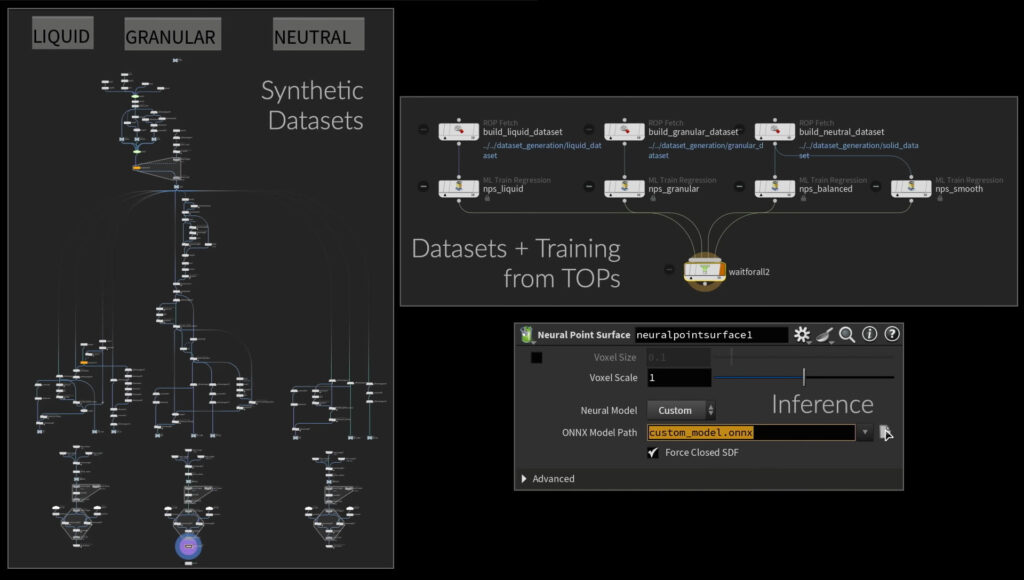

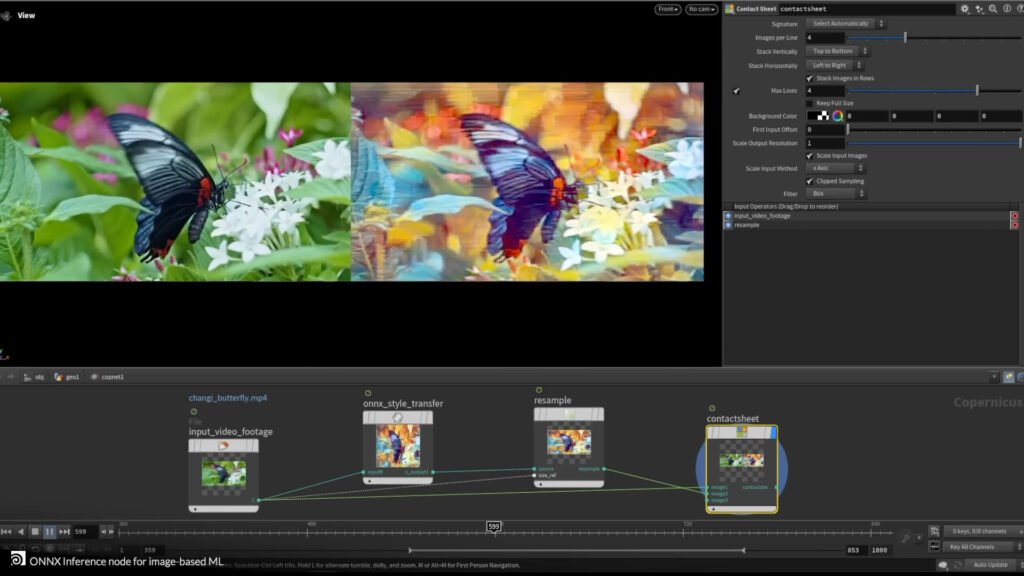

Houdini 21.0 inclus nativement des outils de Machine Learning pour le transfert de style, la déformation de peau et de muscles, le remeshing de surface, l’upres de pyro ainsi que des setups de nodes pour entrainer vos propres modèles avec vos datas.

Neural terrain paint : voir la section heightfields.

Neutral Point Surface (NPS) : voir la section géométries.

Armature deform : Correction des déformations de peau, voir la section muscles.

Pyro Upres : voir la section Pyro.

On retrouve des outils pour entrainer au style transfert ou au denoising, voir section PDG / TOP.

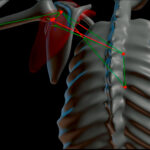

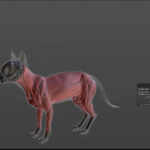

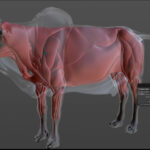

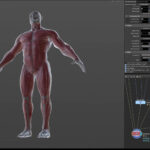

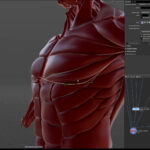

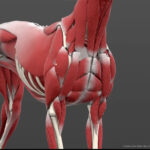

CFX - Muscles

OTiS – « Organic Tissue Solver » : Nouveau solver de tissus 100% accéléré par GPU avec une qualité de résultats similaire aux FEM en beaucoup plus rapide que le FEM et plus rapide que Vellum.

Il gère à la fois la simulation de muscles et celle de peau / graisse. Ce solver maintient le volume des muscles, leur applique des collisions et n’a pas de soucis avec des muscles qui seraient en interpénétration lors de la première frame. Le calcul des collisions semble très robuste.

Nouveaux nodes : « OTiS Configure Muscles & Tissue » pour appliquer les contraintes entre les muscles et d’autres muscles mais aussi entre les muscles et les « tissue » (couches de peau). et « OTiS Solver« .

Otto : Un asset de personnage avec géométrie, texture, squelette modélisé, rig et son système de muscles. (voir section APEX pour le rig) Pour le découvrir trois recettes (recipes) sont disponibles pour tester Otto. « Test Geometry: Otto » pour tester Otto en modeling, « Otto Muscle Transfert » pour tester le transfert de muscle d’un personnage à l’autre et « Otto muscle and tissue Simulation » pour tester Otto en simulation.

Brute : Un autre asset de biped complet ressemblant à un orc.

Muscles Nodes : Nouveaux nodes de « Muscle Auto Tension Lines » pour trouver les automatiquement les attaches sur les os voisins (possibilité d’avoir plusieurs « tension lines » par muscle) et « Muscles Tension Lines Activate » pour gérer l’activation de la flexion des muscles en fonction du facteur de tension de ces lignes et « Muscle Adjust Volume » pour gonfler les muscles artificiellement (sans calcul de tension) avec une collision automatique.

Muscle Solidify : Ce SOP complètement revu permet de générer une couche de peau appelée « Facia » pour maintenir les muscles entre eux permettant d’éviter les petits tremblements de la simulation tout en préservant les mouvements de volumes.

La conversion en tétraèdre est 3-4 fois plus rapide qu’avant.

Muscle Transfert : Permet de transférer les muscles d’un personnage sur un autre ayant un squelette similaire. Un premier node permet d’indiquer quel os correspond à quel autre, puis on peut ajouter des « transforms » manuels et enfin un second muscle transfert permet de transférer les muscles automatiquement. Dans la présentation de Kai Stavginski, il transfert les muscles d’Otto vers Brute, puis d’un chat vers une vache Brahmane.

Topo Slide by Curves : Plutôt qu’un transform pour ajuster la position des os et des muscles, ce nouveau node permet d’ajuster la géométrie via des curves en surface, un peu à la manière d’un « point deformer » préservant le volume.

Skin Deform : Encore un nouveau Quasi-statique déformer accéléra par GPU (comme le vellum brush ou vellum wrikles, c’est une déformation basée sur une simulation par itération plutôt que par frames). L’avantage du quasi-statique est qu’il peut être distribué sur une ferme car il n’y a pas besoin de la frame précédente pour calculer la suivante.

Celui-ci à un système de « skin sliding » (glissement de peau) que l’on peut ajouter en post simulation pour obtenir une peau qui glisse sur les muscles répartissant mieux la tension ou l’écrasement.

On note que le delta mush à aussi été accéléré par GPU.

Armature Capture & Armature Deform : Un autre déformer quasi-statique qui déforme la géométrie en fonction du rig en préservant le volume. Il est bien plus rapide à mettre en place qu’un système de muscles complet. Bien entendu les résultats sont moins bons. On est plus proche d’un bone deform avec une qualité plus haute tout de même.

ML Deform : Cet outil basé sur du Machine Learning pré-entrainé permet de corriger les déformations de la géométrie d’un personnage. Réduisant les interpénétrations et pertes de volumes. Très rapide à appliqué, vous pouvez l’appliquer tout en animant et en attendre des résultats stable entre les différentes poses. Un modèle basé sur le système de muscles d’Otto est déjà entrainé.

La recette « ML Train Deform« vous permet d’entrainer votre propre modèle avec vos données de géométries.

Organic Deformer : Ce nouveau node remplace le rôle des tetmeshes qui sont lourds dans la simulation préservant le volume, il améliore aussi la précision.

MPM

Beaucoup de nouveautés et d’améliorations pour le MPM, 3 nouvelles fonctionnalités et 4 nouvelles nodes :

Surface tension : Un nouveau paramètre de Surface Tension est ajoutée au MPM pour obtenir plus de réalisme dans des simulations au comportement liquide en générant une attraction entre les gouttes. On peut choisir entre « point based » ou « grid based » surface tension avec un paramètre pour la force et un autre pour la taille du kernel (taille des gouttes).

Continuous emission expansion : Cette fonctionnalité permet de sourcer de nouvelles matières au dessus des précédentes en appliquant une pression interne et de l’expansion afin d’obtenir une interaction réaliste et une émission continue malgré le manque de place à la position de l’émetteur

Auto sleeping : Les points peuvent maintenant être désactivés via un auto sleep qui fonctionne sur le même système en simulation de grain classique.

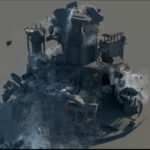

Post Fracture & Deform Pieces : Le node « Post Fracture » prend la dernière frame de la simulation MPM, identifie les blocs de simulation et transfère cet index à la première frame. Le mesh de rendu est ensuite fracturé par cette information d’index et le résultat est déformé avec le node « Deform Pieces ».

Secondary sim & debris source : Il est facile d’identifier où la simulation de MPM se fracture et ainsi utiliser cette zone en active et le reste en passif comme des colliders afin de faire une seconde simulation plus haute résolution. Un genre de upres de la simulation.

De la même manière le débris source permet d’identifier les zones qui se séparent et d’émettre des points pour une simulation de particules afin d’ajouter des micros débris et donc du réalisme.

MPM Surface : Permet de remesher des points de MPM en surface tout en transférant automatique la couleur et les UV par UV island en une seule node.

On note en complément qu’un attribut d’age est maintenant disponible en MPM, que le MPM container peut maintenant avoir un padding.

RBD

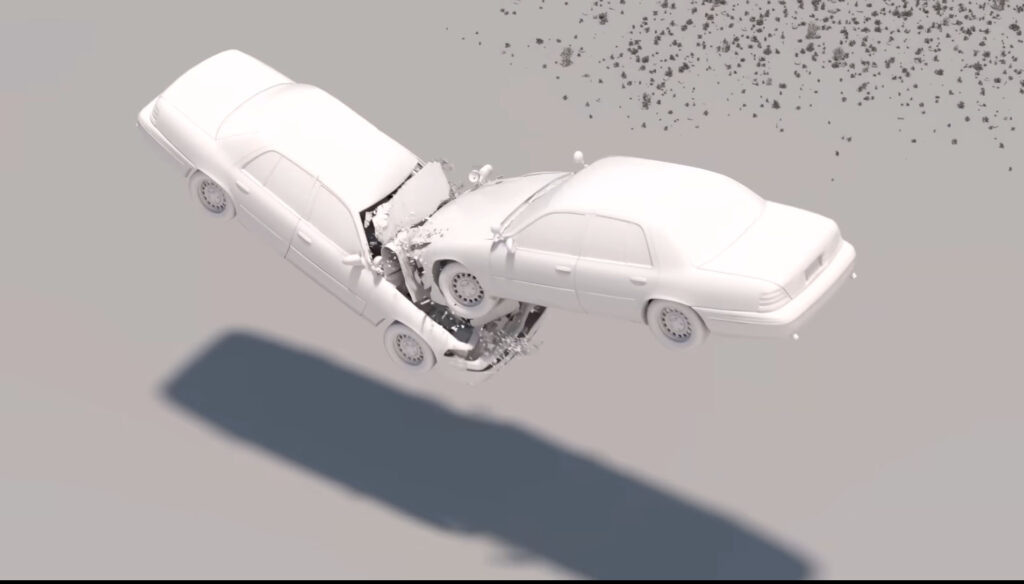

Avec Houdini 20.5 on nous présentait des outils de « Car Rig » pour animer de manière physiquement correcte des véhicules rapidement. Trois nodes étaient disponible « RBD Car Rig« pour générer le rig du véhicule, « RBD Car Follow Path« pour le faire suivre une courbe et « RBD Car Deform » pour ajouter des déformation post simulation.

Avec Houdini 21.0 voici des outils complémentaires pour les détruire / abimer lors des accidents !

RBD Car Fracture : Ce nouveau node permet d’identifier les différentes « sections » , idéalement par matière (métal, plastique, verre …) et l’outil se charge de fracturer la géométrie et de générer un proxy et les contraintes pour vous. Un menu déroulant permet de visualiser rapidement les différents éléments généré mais aussi d’isoler une section ou une autre.

En rentrant dans ce node vous avez la possibilité d’ajouter des contraintes pour par exemple indiquer les charnières des portes ou à quels endroits les différentes sections sont collées / attachées. Ex : le contour du parebrise à l’armature métallique de la voiture

Alexandre Sirois-Vigneux (un Français chez SideFX !) nous indiquer que cet outil de pré-fracturation automatique fonctionne aussi sur une géométrie non préparée pour la destruction. Et bien entendu ça ne s’arrête pas aux voitures, ça fonctionne sur tout type de véhicule.

RBD Car Transform : Un nouveau node permet de transformer la voiture sur les points simulés, ré aligner les roues et ajuster les contraintes de conetwist.

RBD Motors : Une nouvelle option permet d’avoir une partie de la géométrie qui tourne comme pour les hélices de moteur, élionnes, avion / hélicoptère ou ventilateurs.

Bullet Solver : Mise à jour vers la version 3.25

Ragdoll : De très nombreuses mises à jour. voir section anim

Nouvelle contraintes de tether Soft & Hard, mais aussi de parent, static et lookAt ainsi qu’un système d’offset automatique des contraintes.

Il est maintenant possible d’animer les paramètres de stiffness, damping ratio, restlength et d’autres des ragdolls.

Possibilité de positionner la ragdoll via un système de fullBody IK.

ik/fk switch.

Système de baking de cléfs d’animation.

Possibilité d’ajouter des cléfs d’animation aux contrôleurs en symétrie et un nouveau raccourci permet de grossir la selection aux contrôleurs parents / enfants.

Geometry | Modelling

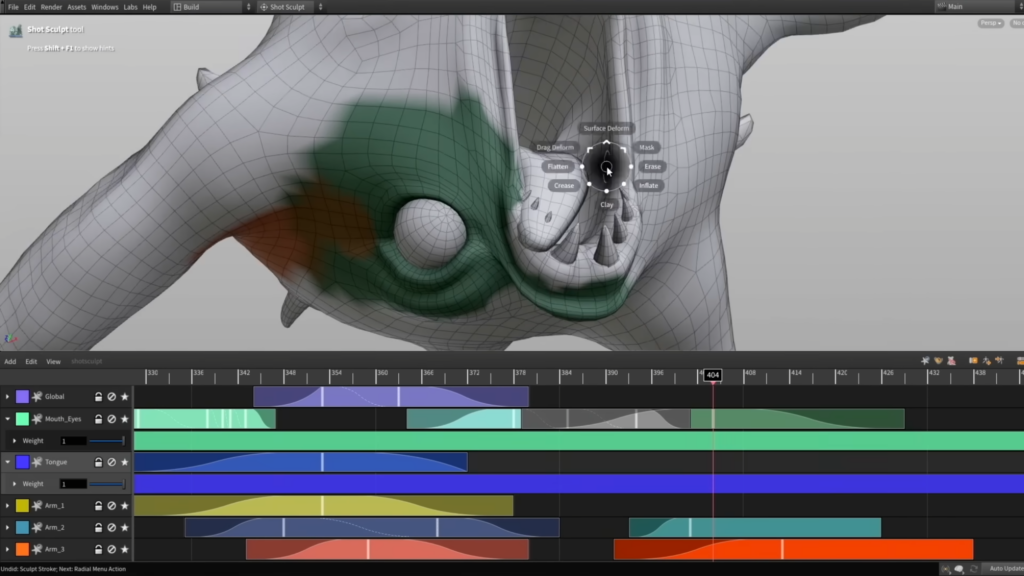

Shot sculpting : Un nouvel outil de sculpt permet de faire du shot finaling sans quitter Houdini, permettant d’ajuster les shapes en sculptant dans le viewport. Ces shapes sont ensuite enregistrées en clip sur l’animation editor pouvant être ainsi cumulés comme des layers. De plus les clips de sculpt ont un weight ajustable avec un dégradé d’animation permettant de les appliquer ou de les retirer progressivement dans le temps.

Très utile pour corriger les interpénétrations, notamment en skin ou en CFX.

On ne sait pas encore comment le node se présentera. Néanmoins on à déjà aperçu un radial menu d’outils de surface et drag deform, flatten, crease, clay, inflate mais aussi de mask et erase. Le sculpt pourra se faire en surface distance.

Super outil, mais qu’en est il des performances ?

MetaHumans : SideFX continue de collaborer avec EPIC qui devrait sortir très prochainement un plugin pour importer les MetaHumans dans Houdini.

On à vu quelques exemples de personnages ultra réalistes avec textures, riggués via APEX.

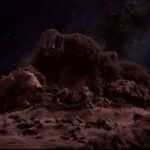

Neutral Point Surface (NPS) : C’est un modèle entrainé pour reconstruire une surface à partir de points en maintenant les détails fins tout en lissant d’avantage les zones planes. il sera typiquement utile pour remesher des liquides ou tout autre conversion de volumes en polygons.

Il a déjà de nombreuses façons de remersher dans Houdini. L’idée ici est d’avoir un système basé sur le machine learning donc qui permet de gagner en rapidité d’execution. Idéalement il produit aussi de meilleurs résultats selon le modèle neuronal utilisé.

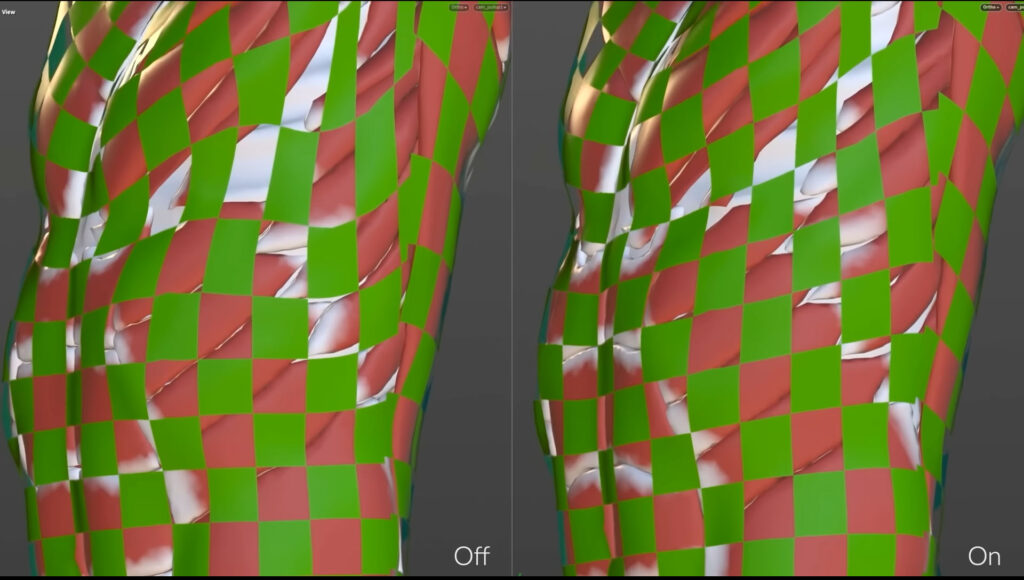

On remarque une légère amélioration de la qualité avec une reflexion

Quadremesher : La difficulté avec le quadremesher est de maintenir les edges saillantes tout en maintenant un maillage uniforme et relaxé. La nouvelle version du quadremesher semble être bien plus performante pour trouver les bons « edges flow » tout en maintenant les edges saillantes. Il est aussi possible de le guider via des groupes d’edges.

Unsubdivide : Comme son nom l’indique ce node fait l’inverse d’un subdivide, il faut bien sur partir d’un mesh qui à une topologie cohérente à une subdivision. Il permet ainsi de réduire la topologie en inversant le procédé plutôt que demander à l’artiste qui l’a fait de revenir en arrière et de republier son asset, ce qui peut prendre beaucoup de temps dans un pipeline complexe. (Vous pouvez choisir l’algorithme de subdivision à utiliser)

UV : Un nouveau sop nommé « UV flattent from points » permet de déplier des zones du mesh basé sur des groupes de points. Un peu comme le UV Unwrap, mais sans plan de projection, les points sont utilisés pour former des groupes de « polygon islands » eux-mêmes dépliées individuellement via un « flatten ».

Le node « UV fuse » fonctionne maintenant dans les blocks compilés

Texture baking : Voir section Copernicus & section Karma.

Environnement - Terrain & biomes

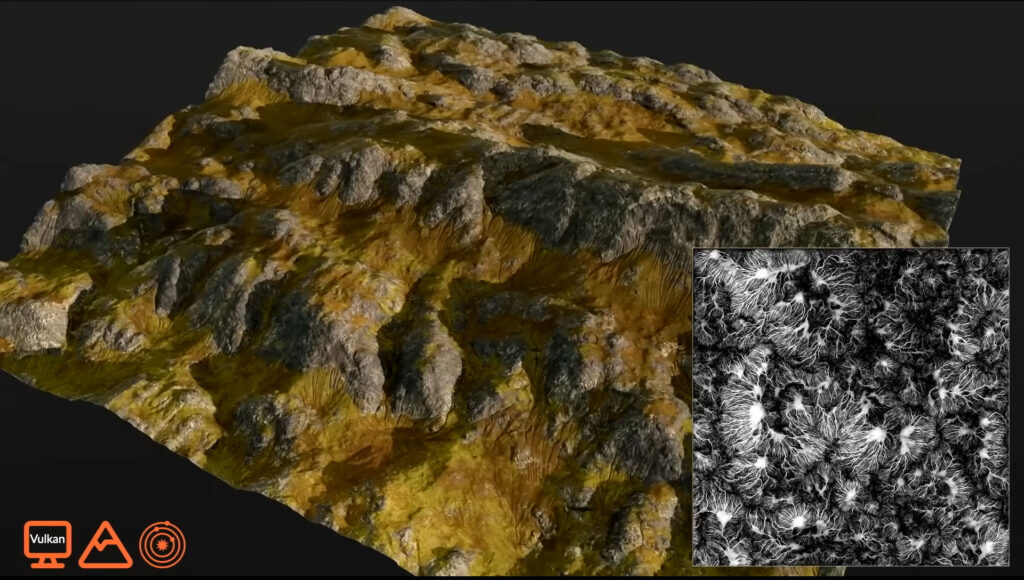

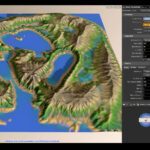

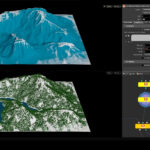

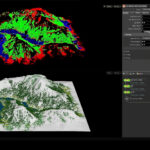

Erosion : Le solver d’érosion des terrains à été complètement repensé (v3) et est maintenant basé sur un solver en COP.

Il s’exécute beaucoup plus rapidement qu’avant, il est obtient des détails plus fins et l’interface est plus intuitif avec bien moins de paramètres.

On retrouve la possibilité d’utiliser des masques et une érosion hydro ou thermale séparée. Il semble aussi être plus simple de les enchainer plusieurs à la suite qu’avant.

HF et COP : Les heigthfields importés en COP restent en 3D et ne sont pas de suite pixellisés, un node de « geo to layer » permet de le faire. Il est possible de calculer la curvature, l’ambient occlusion ou d’autres directement en COP, combinés aux noises, aux scatters et aux nouvelles maps de grunge, le texturing de terrain est beaucoup plus facile à faire. De même pour le terracing des heightfields. Voir la section COP.

Neural terrain paint : Un nouveau SOP node permet de sculpter un heightfield (ou d’en convertir un déjà fait) en utilisant un modèle pré-entrainé pour designer le look du terrain par exemple avec un look et une érosion déjà pré-calculée. Les modèles sont entrainables directement dans Houdini via des outils notamment en TOPs. Le tool est livré avec plusieurs modèles déjà pré-entrainés.

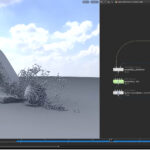

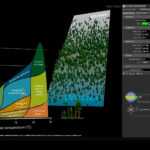

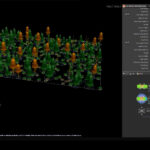

Biomes : Les SOP nodes de biomes sortent en beta et permettent de définir des règles pour peupler des environnements avec des plantes de manière logique et naturelle.

Ils viennent avec des diagrammes viewport interactifs pour rapidement définir le type de terrain, influent sur le type de végétation ou sur la bounding box de chaque type d’arbre pour éviter qu’ils s’interpénètre. On retrouve des outils de peinture, curves ou d’analyse d’image pour définir des zones, mais aussi un scatter intelligents avec collisions et une visualisation sous forme de proxies et de nombreuses metadates en attributs. Le tout compatible Solaris et Unreal.

Des recipes et tests géométries d’arbre et de buissons seront fournis avec Houdini 21.0

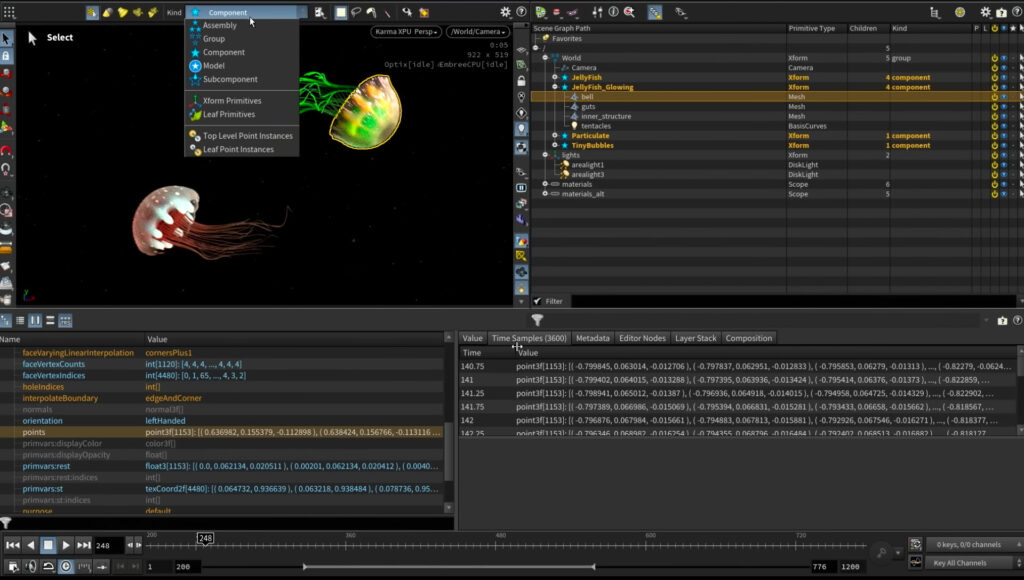

Solaris / USD

Mise à jour de Solaris avec la version 25.05 de l’USD et mise à jour de l’intégration de MaterialX notamment avec les Open PBR shaders.

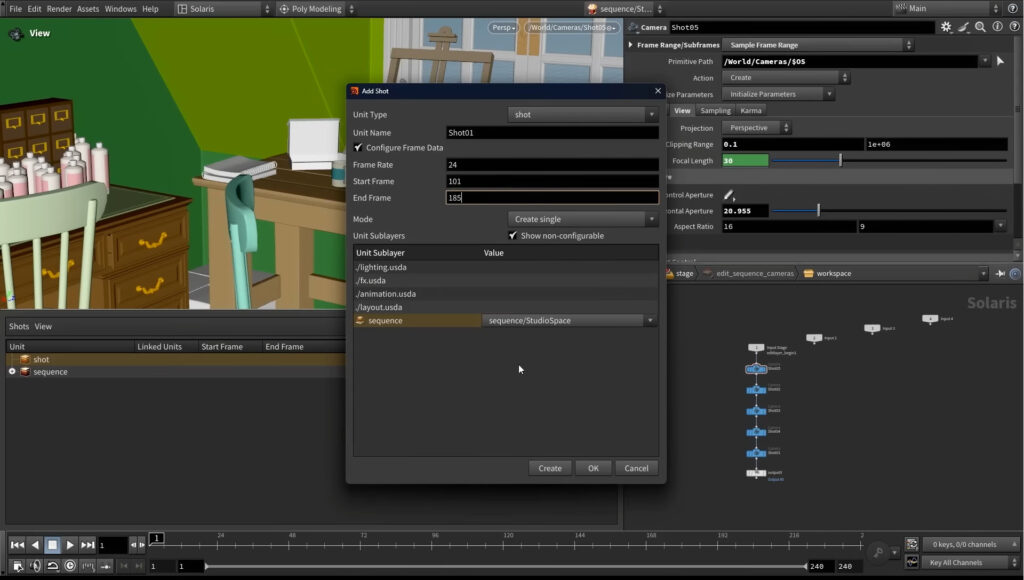

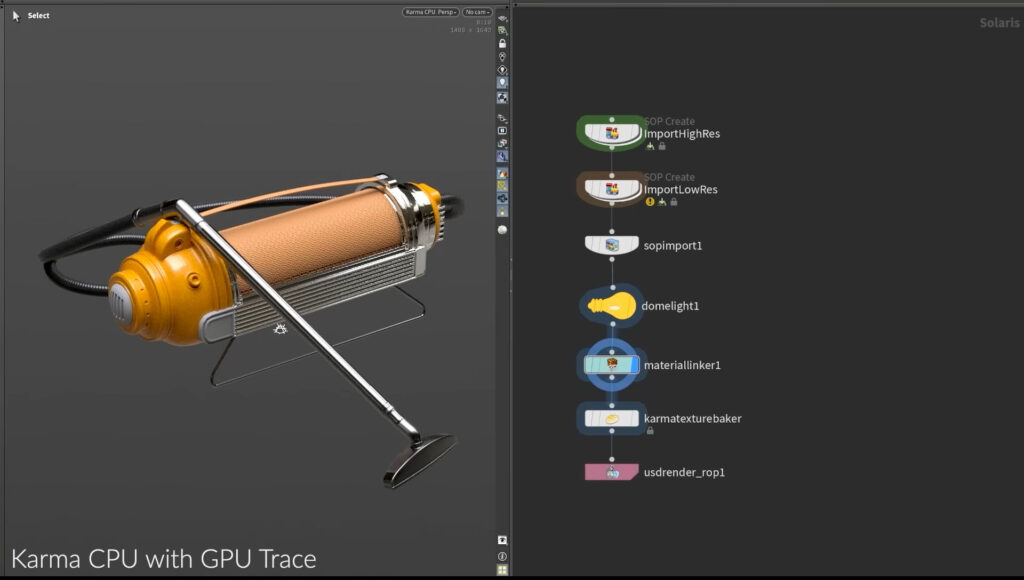

Nouveautés : Une fenêtre de shot builder avec asset resolver, des filtres rapides pour le slapComp, une render gallery IPR et des améliorations d’interface.

Shot Builder : Une nouvelle fenêtre appelée Shot Builder Project premet de créer un projet, des séquences, des shots et des layers dans ces shots. La structure semble être basée sur un fichier json. L’idée ici est de simplifier le pipeline pour les petits studios (les grands ont déjà leur pipeline personnel de construits avec des outils propriétaires).

On retrouve un menu déroulant en haut de l’interface permettant de choisir une séquence ou un shot rapidement, ce qui ajuste les paramètres du « Shot Load ». On retrouve aussi la variable @shot, on imagine aussi @sequence.

On remarque de nouveaux LOP nodes comme le « Shot Load » pour charger le manifest (casting) des layers du shot et le « Shot Layer Edit » permettant d’éditer le contenu de chaque layer d’USD ou encore un « Shot Output » pour exporter l’USD final du shot avec un mode de publish. Ces outils fonctionnent avec un asset resolver pour avoir un certain contrôle sur le versionning des éléments. Ca ne semble pas encore complet.

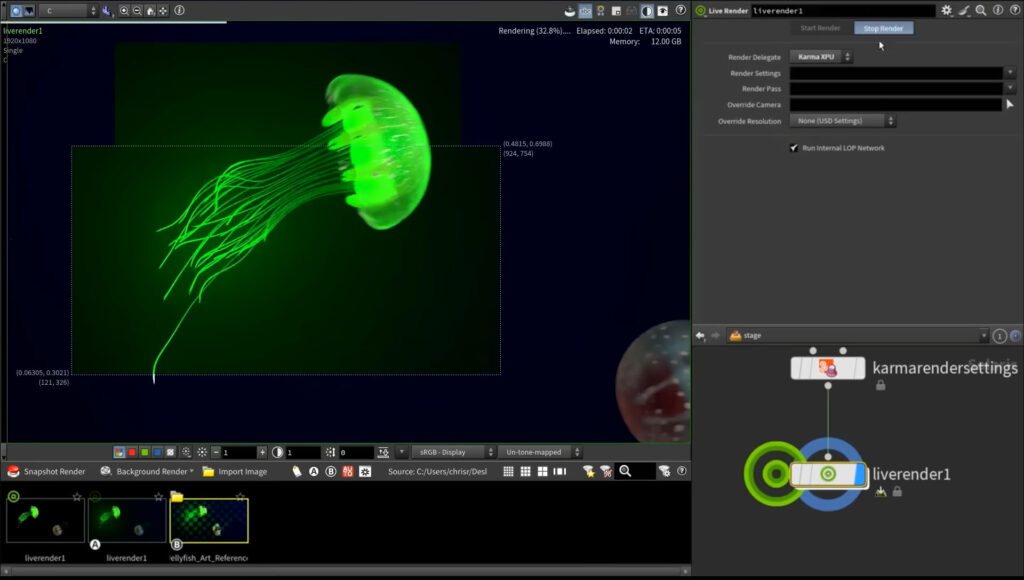

Render Gallery : On remarque aussi la possibilité de charger un rendu depuis le disque dur dans la render gallery.

Un nouveau node appelé livrerender permet d’avoir un rendu ipr dans la render gallery avec la possibilité de définir un « render region »

Slap Comp : Le Live Render peut être importé en COP avec un node de file.

COP Filters : En clic droit sur le bouton pour activer le slap comp sur le viewport on retrouve maintenant des « filtres ». Ceux si sont les outils les plus souvent utilisés comme le blur, glow, HSD adjust etc… Vous pouvez enchainer plusieurs filtres, les réordonner et les enregistrer sous un nom de COP pour rapidement appliquer un style ou un autre. Il s’agit bien de COP mais vous les créer et les éditez sans même entrer dans le contexte de Copernicus. (On les retrouvent dans /img) Ceux ci peuvent aussi être appliqués au rendu sur le node de USD render ROP (comme les COP network habituels)

MaterialX : Nouveau mat nodes « Open PBR surface » et « Open PBR volume » qui sont des uber shader amélioré de MaterialX prévus pour devenir le nouveau standard de l’industrie.

On note la présence d’un subnet de « Surface Flakes » permettant (comme dans de nombreux autres moteurs) de faire des surface avec une réflexion sous forme de paillette comme sur la neige, ou certaines peintures de voiture. A vérifier si celui-ci sera disponible en MaterialX ou Karma node.

Geometry lights : Les primitives avec un shader émissif deviennent de vrais lights sources. C’était déjà possible avant avec Karma, mais c’est maintenant une option USD et donc compatible tout moteurs mis à jour. On remarque un nouveau LOP node « Geometry Light » avec des paramètres séparément pour les réglages USD et ceux Karma. Précédemment on utilisait un « Render Geometry Settings » pour modifier ce type d’options.

Les « Geometry lights » peuvent être des points, curves, meshes ou volume.

USD Configure Prims from Points : Ce nouveau SOP permet de définir rapidement des attributs sur des points qui une fois importés en LOP seront utilisés pour modifier les propriétés des primitives qui y sont instanciées. Dans l’exemple de la keynote on remarque qu’il est utilisé dans un node « Lights from Points » on imagine qu’il s’agit d’un instanceur pour les lights.

Time Samples : Le scène graph detail à maintenant un onglet pour inspecter les time samples, permettant de voir les valeurs des primvar (attributs) à d’autres frames ou interframes. Très pratique pour résoudre les soucis de motion blur.

Interface : On remarque que les icones de kind ont changé avec un look bleu et une iconographie à base d’étoiles.

Drawing mode : Le mode de d’affichage des primitives USD est maintenant dirigé par l’ouverture des sous élements dans la geometry spreadsheet. Ce qui permet d’avoir une bouding box pour tout un batiment si vous ne developpez pas le batiment, en l’ouvrant, vous obtenez une bounding box pour chaque sous primitive qu’il contient (mur, fenetres etc…) Il est possible d’overrider cette visualisation pour toujours afficher d’une manière ou d’une autre avec une nouvelle colonne de draw mode

Karma

Karma utilise Hydra v2.0, on remarque de nouveaux outils pour créer des shader cartoon avec des « outlines », un node de rayswitch, et une propriété de limit color.

Karma Outline Rendering : Une nouvel onglet sur le node de karma render setting fait son apparition. « Outlines » vous permet d’ajuster un contour à vos rendus pour une stylisation plus cartoon. On node de nombreux paramètres comme le radius ou la couleur. On retrouve ces propriétés sur les « render geometry settings » permettant d’ajuster les valeurs par primitive USD.

Ces propriétés viennent avec leurs AOVs et render vars que l’on peut donc utiliser et ajuster depuis le shader.

Karma Ray Switch : Nouveau node qui vous permet d’ajuster des valeurs en fonction du rayon. De cette manière vous pouvez dire mon objet à une base color rouge en camera et vert en diffuse, jaune en réflexion etc… Ainsi l’objet sera rouge en rayon primaires, et jaune ou vert en fonction des rebonds de diffuse ou de réflexion. Il y a une sortie pour le type de rayon permettant par exemple d’utiliser un mix de shader en fonction du type de rayon.

Karma limit color : Nouvelle option dans les Render Geometry Settings pour définir la couleur en limite de rebonds.

Stencil Maps : Cette méthode 25% plus rapide à rendre que du shading avec alpha est maintenant disponible dans Karma. Nous attendons plus d’informations sur ce sujet.

G-splats : Les G-splats sont importables en USD et Karma sait les rendre, ils sont même interprétés dans le viewport Vulkan.

Pour les néophytes, G-splats ça veut dire « 3D Gaussian splatting », c’est une technique de visualisation de nuage de points, interprétés à partir de photos de différents points de vue d’un même sujet. En clair, vous prenez des photos en tournant autour d’un objet, comme un scan, on en déduit des points dans l’espace 3D avec couleur et le G-Splat vient regénérer une surface avec la texture appliquée.

Texture baker : Comme expliqué dans la section COPs, le nouvel outil de bake est disponible en COP et dans Karma. Ici sous la forme d’un node « Karma Texture Baker », il permet d’exporter rapidement toutes les textures que vous pouvez attendre. Analysant la géométrie high res mais aussi le materiel pour baker les informations du shader. Mais comme il est rapide, vous pouvez changer de caméra vers celle appelée __HoudiniTextureBakeCamera et choisir la couche de texture comme une AOV sur la droite du viewport Solaris.

Cette technique utilise un raytracer et à une option pour être dénoisée

Librairie de matériaux : Une nouvelle librairie de matériaux dont les textures sont générées via le COP devrait être disponible dès la prochaine production build. Voir section COP.

Grooming

Hair Shader : Le hair shader à de nouvelles options pour simplifier la transition vers des poils et cheveux mouillés, nous n’avons pas encore plus d’informations sur ce sujet.

Quelques nouveaux nodes :

GuideClumpCenter : pour regénérer les guides depuis les clumps de hairs

GuideSurface : pour générer une surface triangulée sur les grooms de hairs

GuideFill : pour remplir des zones en interpolation des guides existants

GuideFindStray : pour détecter les cheveux qui sortent du mouvement général et les mettre dans un groupe pour un processus après.

PDG / TOPs

ML Train Style Transfert : Solution pour entrainer un modèle de Machine Learning en utilisant deux classes d’images.

ML Train OIDN : Solution pour entrainer un modèle via le dénoiser d’Intel

PDG Training Monitor : Nouveau panneau pour visualiser les modèles et les data entrainées.

Possibilité d’executer du python via un fichier externe en .py

Attrib String Edit : pour modifier les attributs de type string en fonction de filtres.

Deadline Scheduler : est de retour pour lancer des jobs sur la farm.

Vulkan viewport

Le viewport Vulkan à été amélioré et est considéré « production ready » (de notre côté on ne s’avance pas sur ce point).

On retrouve des visualisations temps réel avancées avec le karma physical sky, l’uniforme volume pour donner une impression de brume et de bloom sur le soleil.

Les lumières viewport sont maintenant raytracées et dénoisées en temps réel comme les ombres et l’ambient occlusion. De plus les géométries lights fonctionnent en viewport.

Le mode headlight peut maintenant être modifié en dome light, physical sky ou three point lighting dans les display options.

L’instancing de lumières USD et les shaders OpenPBR (Autodesk x Adobe) sont supportés.

On note le support de :

- MoltenVK pour un Vulkan compatible Mac

- G-splats pour afficher des nuages de points comme surfaces en temps réel

- Stencil maps pour visualiser sur les polygons des textures avec Alpha plus rapidement

Interface

Côté UI / UX, de chouettes nouveautés sont à noter comme le mode « forever playback » permettant de lire une animation indéfiniment, ou le mode « live simulation » pour lancer la simulation sans limite de timeline. Un bouton en bas de l’interface permet de mettre pause.

On retrouve comme lorsque l’on utilise l’UV flatten, une vue qui se split en deux lors de l’utilisation de kineFX pour avoir un espace Rig et un espace viewport en world.

La fenetre d’info à encore été revue dans tous les contextes, et elle est plus rapide. Les poignées des outils ont été redesignées pour se ressembler dans les différents contextes.

Les multi parms peuvent maintenant être réordonnés.

Ctrl + click sur un bouton « reset simulation » permet maintenant de vider le cache.

L’éditeur de raccourcis à été amélioré aussi, notamment avec la possibilité d’assigner des actions à des séquences de boutons.

Une solution dans le labs permet de visualiser les attributs des curves

SideFX Labs

Biomes : voir la section terrains

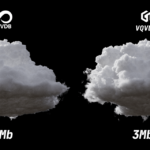

Zibra VDB : Intégration de Zibra pour la compression et décompression VDB et l’export vers les moteurs temps réel, compatible notamment sur Unreal Engine et avec les volumes Houdini, il permet une compression de 97 à 99%. On peut dire que les fichiers seront quasiment 100 fois légers.

Le saviez vous ? Enzo Créma propose une alternative tout aussi efficace et gratuite : VQVDB disponible ici.

Shape Generator : un nouveau node de génération de formes 2D simples avec des poignées fait son apparition. Ainsi qu’un générateur de grille en hexagons.

Plugins : Meilleure intégration d’AliceVision, RizomUV et Exoside. Nouveau : Perforce est installable en option.

IA : Des outils pour étiqueter et rendre des données pour le ML.

Houdini engine

La partenariat entre EPIC et SideFX continue. Tous les exemples de Houdini engine montrés par SideFX sont dans Unreal 5.5 et 5.6, néanmoins on rappel que le plugin doit fonctionner sur Maya, 3DS Max, il à été mis à jour pour leurs versions 2026 ainsi que pour Unity 6.1.

Houdini engine COP support : Vous pouvez modifier vos COPs via Houdini engin

Amélioration de l’exporter de point cloud pour fonctioner avec la Génération Procédural de Contenu (PCG) dans Unreal Engine. Il est maintenant possible d’utiliser les HDA dans les graphs PCG.

Transfert de curve entre Houdini et Unreal amélioré.

Amélioration du l’importeur de Vertex Animation Texture (VAT) pour Unreal Engine

Améliration dans Houdini Engine pour 3DSmax avec un Log et un panneau HDA.

Python 3.11 seulement.

Pour une liste complète des nouveautés et améliorations de Houdini 21.0 rdv sur : https://www.sidefx.com/forum/topic/101604/

Et dans Houdini 21.5 ?

Nous n’avons pas d’informations solides à ce sujet, néanmoins on sait dans quelle direction SideFX cherche à aller. On peut imaginer la suite :

- Les nodes de copernicus ont été grandement améliorées en rapidité. Il y a eu des nouveautés comme le Texture Mask Paint SOP, et le tool de shot sculpting. La suite logique c’est un outil de peinture temps réel sur la géométrie pour générer des textures comme dans Painter.

- Un amélioration des performances d’anim, de shot sculpting et de la plupart des derniers outils amenés dans Houdini.

- Des brush pour un outils de sculpting basé sur le VDB comme dans Zbrush ou Blender.

- Des outils de compositing avancés comme du tracking, keying et de la rotoscopie vectorielle proche du node de curve.

- Un outil d’animation vectorielle 2D.

- De nouveaux exemples de Machine Learning. Par exemple de la rotoscopie.

- Des micros solver complémentaires pour le pyro en COP.

- Encore plus de recipes pour faciliter la mise en place d’effets.

- Et on espère plus de débugs du Vulkan viewport.

La formation est ouverte à tous les graphistes, même si vous ne travaillez pas chez SuperProd. C’est l’occasion de rencontrer les équipes du studio !

La formation est ouverte à tous les graphistes, même si vous ne travaillez pas chez SuperProd. C’est l’occasion de rencontrer les équipes du studio ! Inscrivez vous via

Inscrivez vous via  Cette formation est certifiée Qualiopi et finançable par les OPCO.

Cette formation est certifiée Qualiopi et finançable par les OPCO.